- Messaggi

- 24,517

- Reazioni

- 11,322

- Punteggio

- 248

Ragazzi manteniamoci calmi eh.

Segui il video qui sotto per vedere come installare il nostro sito come web app sulla tua schermata principale.

Nota: Questa funzionalità potrebbe non essere disponibile in alcuni browser.

Pubblicità

Non so, si può trollare a generare flame allora? Da quando?Ragazzi manteniamoci calmi eh.

Si...poi passi alla pagina multi thread e l'a17 pro svanisce (com'è giusto che sia). Certo, come dici potrebbero aggiungere dei core...ma la domanda è pensi che i core aggiuntivi non necessiteranno di raffreddamento attivo? Pensi che nei chip basta aggiungere pezzi come un puzzle mantenendo la stessa scalabilità ecc...?Per i fan di x86:

PassMark CPU Benchmarks - Single Thread Performance

Benchmarks of the single thread performance of CPUs. This chart comparing CPUs single thread performance is made using thousands of PerformanceTest benchmark results and is updated daily.www.cpubenchmark.net

Il settimo della lista è una CPU ARM 64 bit (A17 Pro) presente su un telefono, inferiore in performance rispetto al Snapdragon X Elite (per ora solo sulla carta ma se quello che si legge è vero forse anche nella realtà).

Altro che raffreddamento a liquido! Non c'è neppure la ventola sull'iPhone 15!

--- i due messaggi sono stati uniti ---

Speriamo che su questi ARM mettano un po' più di core, i 12 core dello Snapdragon fanno ridere. AMD riesce a metterne quasi 100 su una piattaforma x86 (7995WX). Speriamo che RAM ed SSD non siano integrati nella cpu come fa adesso il fruttivendolo (scusate se lo chiamo così ma è una politica che non apprezzo) e che si possa continuare ad aggiungere memoria anche dopo l'acquisto del device. Un SSD veloce da 8TB nvme costa uno sproposito in questo momento, stesso discorso per la RAM, ancora troppo cara e sempre non ECC.

Io non vado giù pesante, mai.. ma se continua vedrai che verranno presi provvedimenti più importanti di un semplice richiamo verbale.Non so, si può trollare a generare flame allora? Da quando?

Hai spiegato tutto benissimo, ma hai tralasciato la parte più importante per il nostro utente, il rumore! Lui di questo si lamenta, che x86 fa "rumore" mentre ARM no, e penso che con questa spiegazione avrai sfatato questo falso mito.Secondo me in tutti i discorsi fatti manca un dettaglio fondamentale.

Premettendo che il confronto a livello di prestazioni tra ARM e X86 è difficile perchè non si riesce fare a parità di software, se prendiamo ad esempio M1 Ultra o M2 Ultra che costituiscono il top dell'offerta Apple, quindi il top dell'offerta ARM in questo momento, sono effettivamente CPU molto veloci e integrano al loro interno anche una potente GPU.

Però l'M2 Ultra è una "pizza" di chip che integra 132 milioni di transistor! Un chip enorme, più grosso di una RTX4090 (76 milioni) e un Ryzen 9 7950X (16.5 milioni circa) messi insieme. Tra l'altro un chip monolitico di tali dimensioni si porta dietro anche un deficit non trascurabile di resa rispetto a chip più piccoli, a parità di processo produttivo, quindi Apple un M2 Ultra lo paga una barca di soldi. Di conseguenza non sono sicuro che ARM ad oggi sia superiore a X86 nella metrica più fondamentale per chi produce hardware, ovvero il rapporto dimensioni\prestazioni. Poi è chiaro che è un discorso un po' campato per aria proprio per le difficoltà intrinseche nel confrontare sistemi così diversi.

Dal punto di vista dell'efficienza, l'implementazione ARM di Apple è sicuramente notevole, ma attenzione a non sottovalutare X86. Il problema delle CPU e GPU top di gamma attuali è che sono spremute allo stremo per dare più prestazioni possibili a discapito dell'efficienza. Ma si potrebbero utilizzare in modo molto più efficiente solo rivedendo tensioni e frequenze, scegliendo parametri un po' meno estremi.

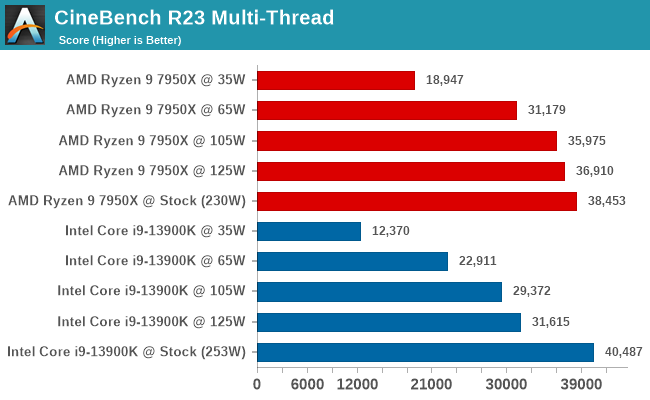

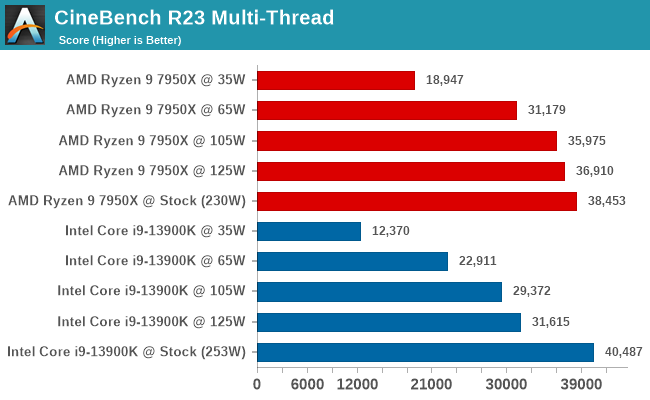

fonte: https://www.anandtech.com/show/17641/lighter-touch-cpu-power-scaling-13900k-7950x/2

Con un 7950x praticamente si può dimezzare la potenza assorbita con una perdita di prestazioni quasi trascurabile (intorno al 6%). Addirittura mantiene buone prestazioni fino a 65 watt, poco più di 1/4 di quello che assorbe a stock.

Su Intel va un po' peggio, ma Intel è indietro di un nodo produttivo rispetto ad AMD (rispetto ad Apple anche di più) e questo inevitabilmente pesa sull'efficienza.

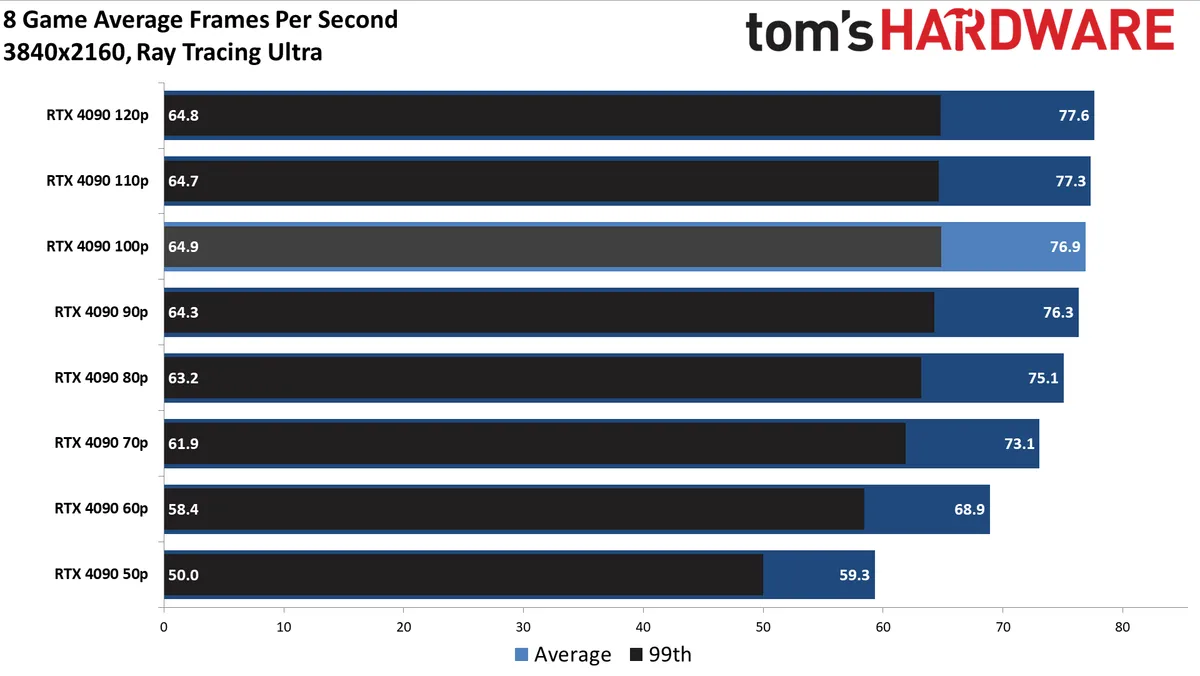

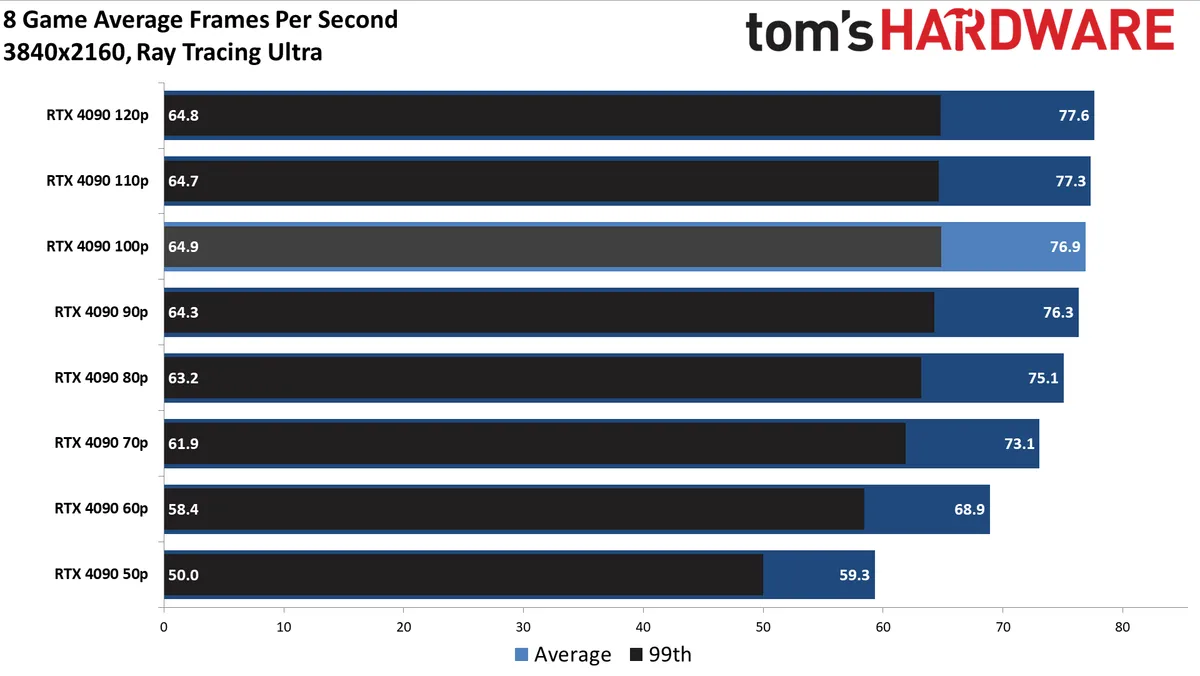

Un discorso analogo, anche se un po' meno estremo, vale per la RTX4090:

fonte: https://www.tomshardware.com/news/improving-nvidia-rtx-4090-efficiency-through-power-limiting

Quindi secondo me non è tanto una questione di architettura, ma di come si usa l'hardware. Se i produttori iniziassero a ottimizzare maggiormente i propri sistemi per l'efficienza invece che per la prestazione pura si otterrebbe grossi miglioramenti di efficienza (e quindi anche di temperature) anche senza stravolgere nulla lato architettura.

Hai spiegato tutto benissimo, ma hai tralasciato la parte più importante per il nostro utente, il rumore! Lui di questo si lamenta, che x86 fa "rumore" mentre ARM no, e penso che con questa spiegazione avrai sfatato questo falso mito.

Una volta impostati i power limit a dovere avrai un sistema in grado di girare tranquillamente a temperature tali da non dover far andare a palla il sistema di dissipazione, liquido o ad aria che sia.

Ma sono abbastanza sicuro che l'utente in questione dirà che lui una volta comprata la cpu non toccherà i valori preimpostati dalla fabbrica, cosa che ricordo in un'altra sua discussione..