Secondo me in tutti i discorsi fatti manca un dettaglio fondamentale.

Premettendo che il confronto a livello di prestazioni tra ARM e X86 è difficile perchè non si riesce fare a parità di software, se prendiamo ad esempio M1 Ultra o M2 Ultra che costituiscono il top dell'offerta Apple, quindi il top dell'offerta ARM in questo momento, sono effettivamente CPU molto veloci e integrano al loro interno anche una potente GPU.

Però l'M2 Ultra è una "pizza" di chip che integra 132 milioni di transistor! Un chip enorme, più grosso di una RTX4090 (76 milioni) e un Ryzen 9 7950X (16.5 milioni circa) messi insieme. Tra l'altro un chip monolitico di tali dimensioni si porta dietro anche un deficit non trascurabile di resa rispetto a chip più piccoli, a parità di processo produttivo, quindi Apple un M2 Ultra lo paga una barca di soldi. Di conseguenza non sono sicuro che ARM ad oggi sia superiore a X86 nella metrica più fondamentale per chi produce hardware, ovvero il rapporto dimensioni\prestazioni. Poi è chiaro che è un discorso un po' campato per aria proprio per le difficoltà intrinseche nel confrontare sistemi così diversi.

Dal punto di vista dell'efficienza, l'implementazione ARM di Apple è sicuramente notevole, ma attenzione a non sottovalutare X86. Il problema delle CPU e GPU top di gamma attuali è che sono spremute allo stremo per dare più prestazioni possibili a discapito dell'efficienza. Ma si potrebbero utilizzare in modo molto più efficiente solo rivedendo tensioni e frequenze, scegliendo parametri un po' meno estremi.

fonte:

https://www.anandtech.com/show/17641/lighter-touch-cpu-power-scaling-13900k-7950x/2

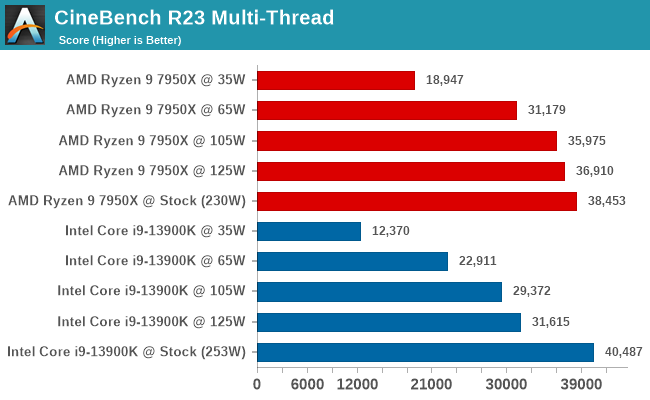

Con un 7950x praticamente si può dimezzare la potenza assorbita con una perdita di prestazioni quasi trascurabile (intorno al 6%). Addirittura mantiene buone prestazioni fino a 65 watt, poco più di 1/4 di quello che assorbe a stock.

Su Intel va un po' peggio, ma Intel è indietro di un nodo produttivo rispetto ad AMD (rispetto ad Apple anche di più) e questo inevitabilmente pesa sull'efficienza.

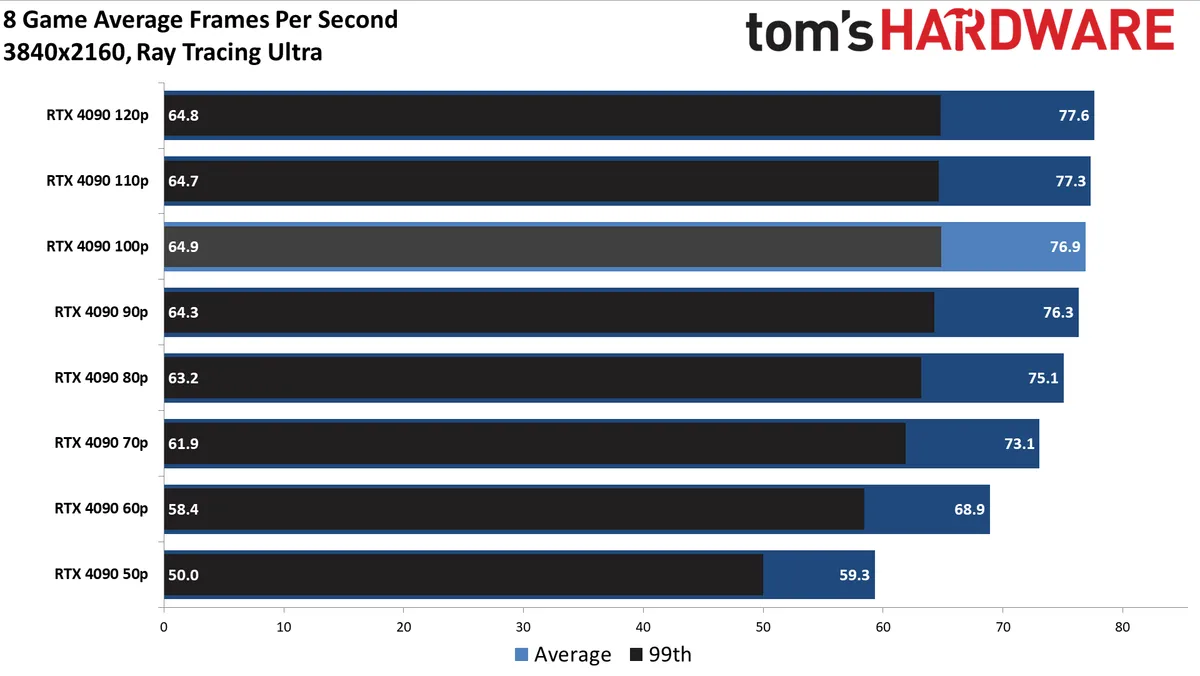

Un discorso analogo, anche se un po' meno estremo, vale per la RTX4090:

fonte:

https://www.tomshardware.com/news/improving-nvidia-rtx-4090-efficiency-through-power-limiting

Quindi secondo me non è tanto una questione di architettura, ma di come si usa l'hardware. Se i produttori iniziassero a ottimizzare maggiormente i propri sistemi per l'efficienza invece che per la prestazione pura si otterrebbe grossi miglioramenti di efficienza (e quindi anche di temperature) anche senza stravolgere nulla lato architettura.