U

Utente cancellato 159815

Ospite

ASPETTANDO NVIDIA PASCAL

Prevista per la metà del 2016, l'architettura Nvidia Pascal sarà la GPU che sostituirà tutte le attuali proposte Maxwell, portando con se un'autentica rivoluzione in quasi tutti gli aspetti dell'elaborazione 3d e del gaming.

Pensata fin da subito con 2 direzioni portanti, risparmio energetico e Deep Learning, introdurrà a supporto una rielaborazione degli aspetti basilari della GPU:

- calcoli a precisione mista (con un raddoppio delle precisione sui calcoli FP 16 bit)

- memorie 3d fino a 32 gb (migliori consumi e circa 3 volte la banda di Maxwell)

- Nv Link (con banda 12 volte superiore rispetto a pci express)

Il processo produttivo verrà affidato a TMSC e utilizzerà una miniaturizzazione FinFET a 16 nm, che è un bel balzo dall'attuale 28 nm.

Il 5 giugno è stata riportata la notizia del primo Tapeout del chip GP100

Dati ufficiali GP 100:

610 nm2 di dimensione, una delle GPU più grandi di sempre

16 nm processo produttivo (e già si sapeva)

4096 Bit di banda (4 x 512)

15, 3 milioni di transistor

224 TMU (192 Maxwell)

Gpu speed 1328 Mhz (1480 boost)

16 Gb ram

3840 cuda cores

300W Tdp

I cambi architetturali riguardano sostanzialmente le distribuzione dei carichi che ora diventa terribilmente più efficiente.

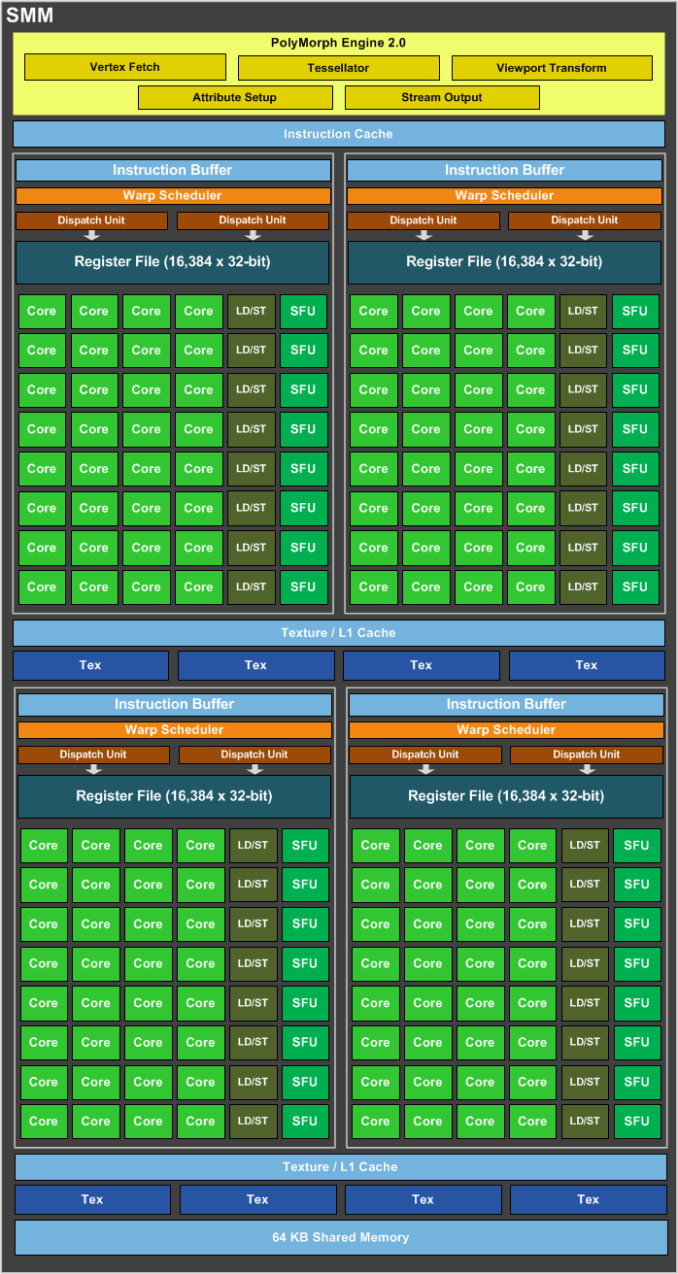

Abbiamo 6 Graphics Processing Clusters divisi in 10 Pascal Streaming Multiprocessors divisi in 2 blocchi da 32 cuda cores ognuno con una instruction cache condivisa mentre l'instruction buffer, warp shedule, 2 dispatch units oltre che i registri sono specifici per ogni segmento PSM. Tutto molto simile a Maxwell, ma con i PSM che hanno la metà dei CUDA rispetto ai SMM di Maxwell mantenendo lo stesso numero di registri.

Questo è Pascal:

Questo Maxwell:

La conseguenza di tutto ciò, oltre l'efficienza, è un raddoppio dei registri per CUDA con conseguente aumento esponenziale delle possibilità di calcolo parallelo.

Hanno inoltre aggiornato lo Scheduler, che bisognerà verificare a questo punto il comportamento con l'elaborazione dell'Async compute, il rapporto FP32-FP64 è tornato 2 a 1, da 32 a 1 di Maxwell, insomma un gran pezzo di HW.

La scheda a quanto pare, in versione FULL:

I 16 nm FinFET uguali ai 14 nm Intel/Samsung?

[SUB]A quanto pare è proprio così, TSMC considera la denominazione di grandezza del transistor dal lato più ampio, mentre Intel/samsung da quello più corto. Detto questo in rapporto ai 28nm attuali i transistor sono grossi la metà.

[/SUB]Roadmap:

In aggiornamento man mano...

- - - Updated - - -

Ovviamente il 3d è ancora povero e verrà aggiornato man mano, ma credo sia tempo di iniziare a raccogliere informazioni rispetto alla nuova architettura Nvidia, ovviamente mandatemi segnalazioni in privato e supportate il 3d come al solito.

Ultima modifica da un moderatore: